Nos últimos anos, roboticistas e cientistas da computação vêm desenvolvendo uma ampla gama de sistemas que podem detectar objetos em seu ambiente e navegar de acordo. A maioria desses sistemas é baseada em algoritmos de aprendizado de máquina e aprendizado profundo treinados em grandes conjuntos de dados de imagens.

Embora existam hoje inúmeros conjuntos de dados de imagens para treinamento de modelos de aprendizado de máquina, aqueles que contêm dados coletados por meio de sensores de radar ainda são escassos, apesar das vantagens significativas dos radares sobre os sensores ópticos. Além disso, muitos dos conjuntos de dados de radar de código aberto disponíveis não são fáceis de usar para diferentes aplicativos de usuário.

Pesquisadores da Universidade do Arizona desenvolveram recentemente uma nova abordagem para gerar automaticamente conjuntos de dados contendo imagens de câmeras de dados de radar rotuladas. Essa abordagem, apresentada em um artigo publicado no IEEE Robotics and Automation Letters, usa um algoritmo de detecção de objetos altamente preciso no fluxo de imagem da câmera (chamado YOLO) e uma técnica de associação (conhecida como algoritmo húngaro) para rotular a nuvem de pontos do radar.

“Aplicativos de aprendizado profundo usando radar exigem muitos dados de treinamento rotulados, e rotular dados de radar não é trivial, um processo extremamente demorado e trabalhoso, realizado principalmente comparando-o manualmente com um fluxo de dados de imagem obtido paralelamente”, Arindam Sengupta, Ph.D. estudante da Universidade do Arizona e pesquisador principal do estudo, disse ao TechXplore. “Nossa ideia aqui era que, se a câmera e o radar estivessem olhando para o mesmo objeto, em vez de olhar as imagens manualmente, poderíamos alavancar uma estrutura de detecção de objetos baseada em imagem (YOLO no nosso caso) para rotular automaticamente os dados do radar”.

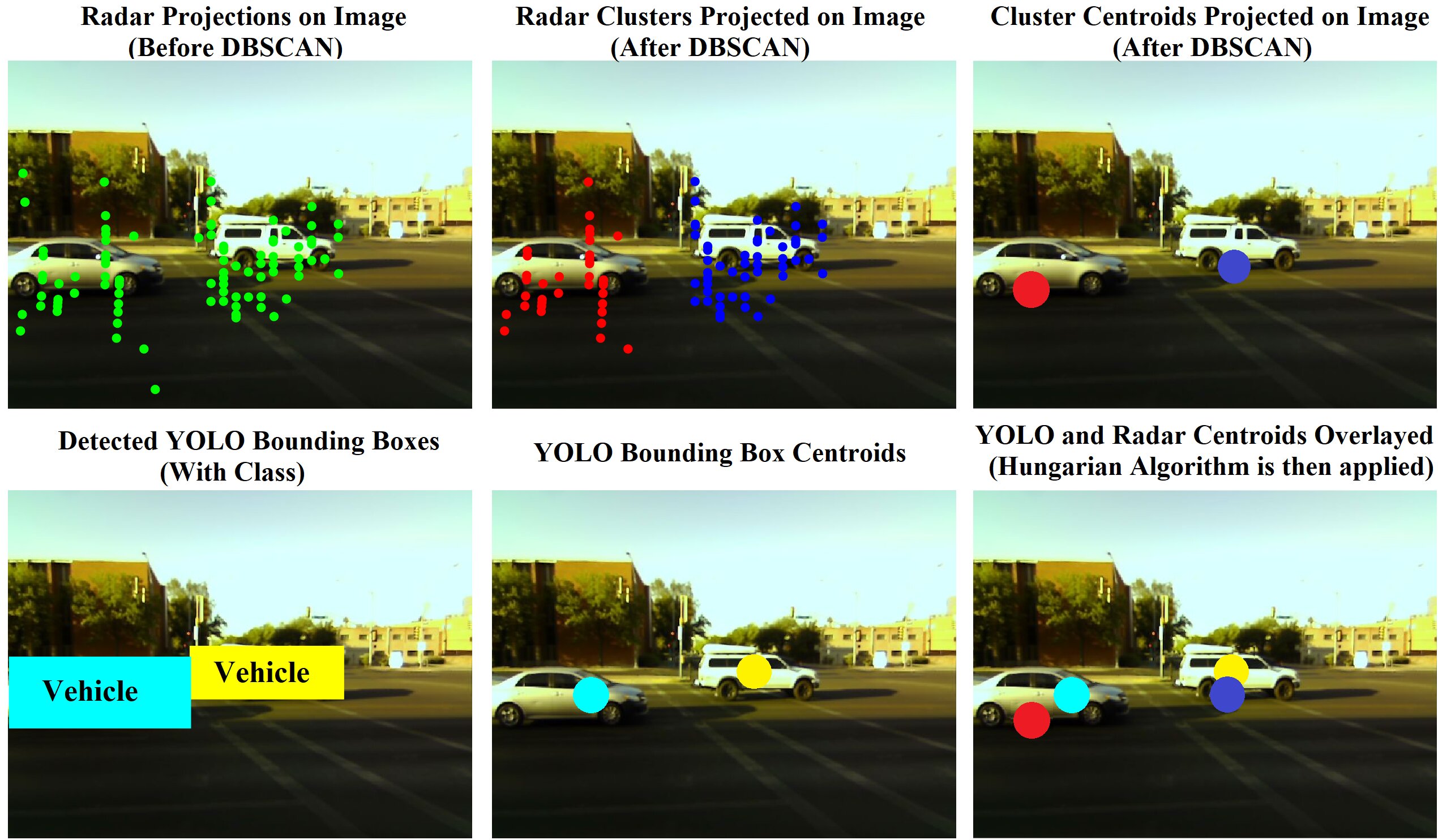

Três características que caracterizam a abordagem introduzida por Sengupta e seus colegas são suas capacidades de co-calibração, agrupamento e associação. A abordagem co-calibra um radar e sua câmera para determinar como a localização de um objeto detectado pelo radar se traduziria em termos de pixels digitais de uma câmera.

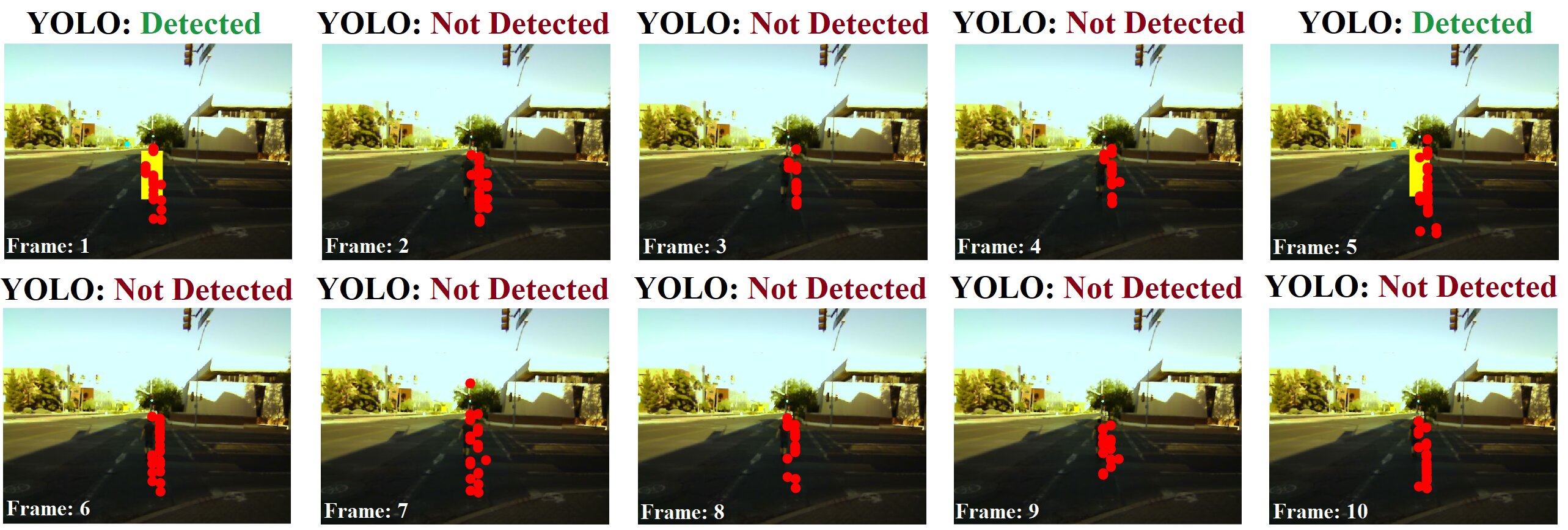

“Usamos um esquema de agrupamento baseado em densidade (DBSCAN) para a) detectar e remover ruídos/retornos de radar dispersos; e b) segregar os retornos de radar em agrupamentos para distinguir entre objetos distintos”, disse Sengupta. “Finalmente, um algoritmo húngaro (HA) intraquadro e interquadro é usado para associação. os clusters de radar pertencentes ao mesmo objeto em quadros consecutivos para explicar a rotulagem de dados de radar em quadros, mesmo quando os sensores ópticos falham intermitentemente.”

No futuro, a nova abordagem introduzida por essa equipe de pesquisadores pode ajudar a automatizar a geração de conjuntos de dados de câmera de radar e apenas de radar. Além disso, em seu artigo, a equipe explorou os esquemas de classificação de prova de conceito com base em uma abordagem de fusão de sensores de câmera de radar e em dados coletados apenas por radares.

“Também sugerimos o uso de um vetor de recursos de radar de 12 dimensões eficaz, construído usando uma combinação de estatísticas espaciais, Doppler e RCS, em vez do uso tradicional de apenas a distribuição de nuvem de pontos ou apenas os dados de micro-doppler”. disse Sengupta.

Em última análise, o estudo recente realizado por Sengupta e seus colegas pode abrir novas possibilidades para a rápida investigação e treinamento de modelos baseados em aprendizado profundo para classificar ou rastrear objetos usando fusão de sensores. Esses modelos podem ajudar a melhorar o desempenho de vários sistemas robóticos, desde veículos autônomos até pequenos robôs.

“Nosso laboratório na Universidade do Arizona realiza pesquisas sobre pesquisa de radar mmWave orientada por dados visando domínios autônomos, de saúde, defesa e transporte”, disse Siyang Cao, professor assistente da Universidade do Arizona e pesquisador principal do estudo, ao TechXplore . “Algumas de nossas pesquisas em andamento incluem a investigação de esquemas robustos de rastreamento baseados em fusão de sensores e a melhoria da percepção de radar mmWave autônomo usando processamento de sinal clássico e aprendizado profundo”.

Publicado em 01/03/2022 20h07

Artigo original:

Estudo original: