As câmeras de tamanho pequeno têm grande potencial para detectar problemas no corpo humano e permitir a detecção de robôs superpequenos, mas abordagens anteriores capturavam imagens distorcidas e confusas com campos de visão limitados.

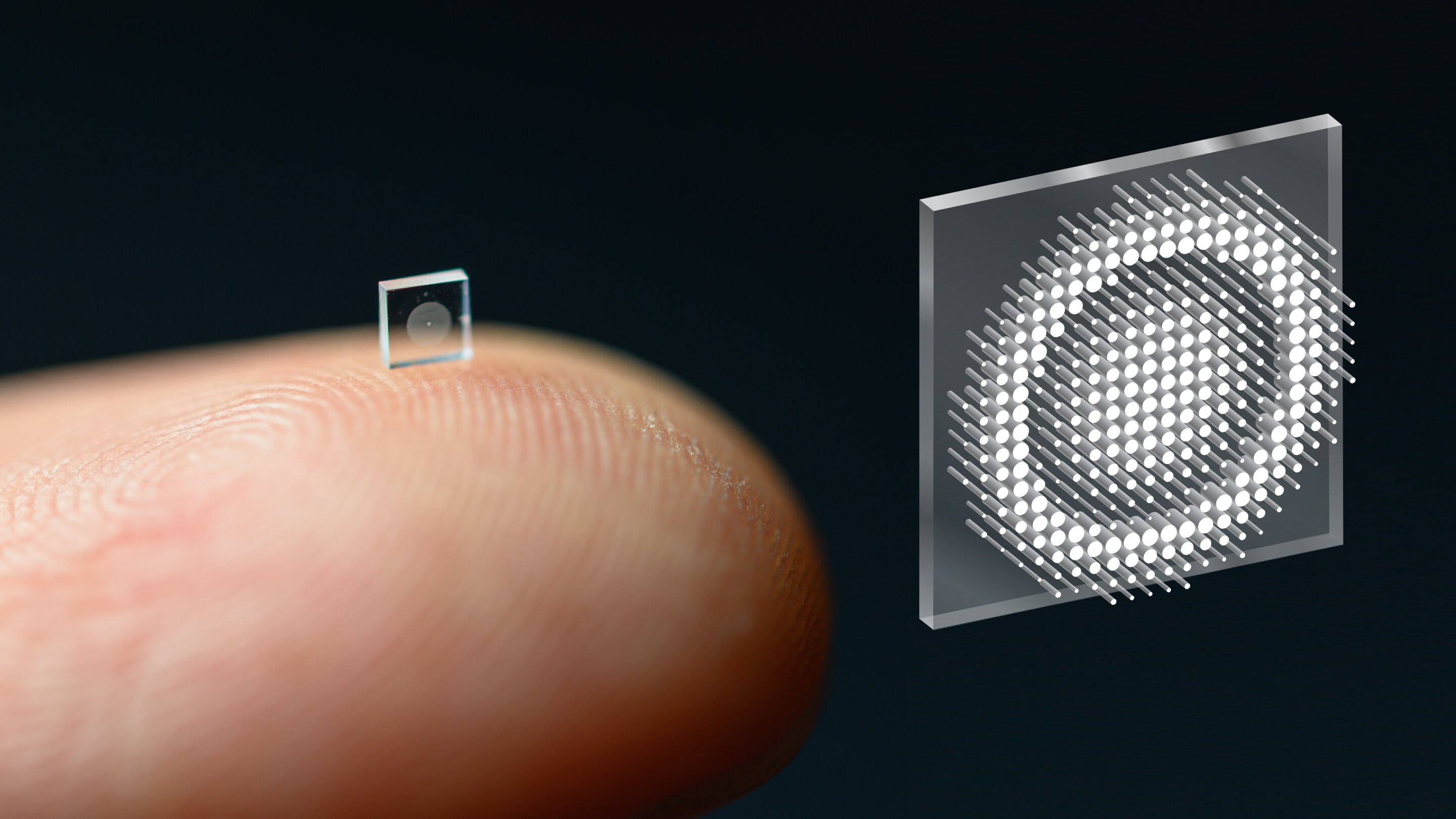

Agora, pesquisadores da Princeton University e da University of Washington superaram esses obstáculos com uma câmera ultracompacta do tamanho de um grão de sal grosso. O novo sistema pode produzir imagens nítidas e coloridas no mesmo nível de uma lente de câmera composta convencional 500.000 vezes maior em volume, relataram os pesquisadores em um artigo publicado em 29 de novembro na Nature Communications.

Habilitado por um design conjunto do hardware da câmera e do processamento computacional, o sistema pode permitir a endoscopia minimamente invasiva com robôs médicos para diagnosticar e tratar doenças e melhorar a imagem de outros robôs com restrições de tamanho e peso. Matrizes de milhares dessas câmeras poderiam ser usadas para detecção de toda a cena, transformando superfícies em câmeras.

Enquanto uma câmera tradicional usa uma série de lentes curvas de vidro ou plástico para direcionar os raios de luz para o foco, o novo sistema óptico se baseia em uma tecnologia chamada metassuperfície, que pode ser produzida como um chip de computador. Com apenas meio milímetro de largura, a metassuperfície é cravejada de 1,6 milhão de pinos cilíndricos, cada um com aproximadamente o tamanho do vírus da imunodeficiência humana (HIV).

Cada poste possui uma geometria única e funciona como uma antena óptica. É necessário variar o design de cada coluna para dar forma correta a toda a frente de onda óptica. Com a ajuda de algoritmos baseados em aprendizado de máquina, as interações das postagens com a luz se combinam para produzir imagens da mais alta qualidade e o mais amplo campo de visão para uma câmera metassuperfície colorida desenvolvida até hoje.

Uma inovação importante na criação da câmera foi o design integrado da superfície óptica e os algoritmos de processamento de sinal que produzem a imagem. Isso aumentou o desempenho da câmera em condições de luz natural, em contraste com as câmeras metassuperfície anteriores que exigiam luz laser pura de um laboratório ou outras condições ideais para produzir imagens de alta qualidade, disse Felix Heide, autor sênior do estudo e professor assistente de computação ciência em Princeton.

Os pesquisadores compararam as imagens produzidas com seu sistema com os resultados de câmeras anteriores de metassuperfície, bem como imagens capturadas por uma óptica composta convencional que usa uma série de seis lentes refrativas. Além de um pouco de desfoque nas bordas do quadro, as imagens da câmera de tamanho nano eram comparáveis às da configuração de lente tradicional, que é mais de 500.000 vezes maior em volume.

Outras lentes metassuperfície ultracompactas sofreram grandes distorções de imagem, pequenos campos de visão e capacidade limitada de capturar todo o espectro de luz visível – referido como imagem RGB porque combina vermelho, verde e azul para produzir tons diferentes.

“Tem sido um desafio projetar e configurar essas pequenas microestruturas para fazer o que você quer”, disse Ethan Tseng, um Ph.D. em ciência da computação. estudante de Princeton que co-liderou o estudo. “Para esta tarefa específica de capturar imagens RGB de grande campo de visão, é um desafio porque existem milhões dessas pequenas microestruturas e não está claro como projetá-las de maneira ideal.”

O co-autor Shane Colburn enfrentou esse desafio criando um simulador computacional para automatizar o teste de diferentes configurações de nanoantenas. Por causa do número de antenas e da complexidade de suas interações com a luz, esse tipo de simulação pode usar “grandes quantidades de memória e tempo”, disse Colburn. Ele desenvolveu um modelo para aproximar com eficiência as capacidades de produção de imagens das metassuperfícies com precisão suficiente.

Colburn, que conduziu o trabalho como um Ph.D. estudante do Departamento de Engenharia Elétrica e de Computação da Universidade de Washington (UW ECE), onde agora é professor assistente afiliado. Ele também dirige o projeto de sistema na Tunoptix, uma empresa com sede em Seattle que está comercializando tecnologias de imagem de metassuperfície. A Tunoptix foi co-fundada pelo conselheiro graduado de Colburn, Arka Majumdar, professor associado da Universidade de Washington nos departamentos de ECE e física e co-autor do estudo.

Co-autor James Whitehead, Ph.D. aluno da UW ECE, fabricou as metassuperfícies, que são baseadas em nitreto de silício, um material semelhante ao vidro que é compatível com os métodos de fabricação de semicondutores padrão usados para chips de computador – o que significa que um determinado projeto de metassuperfície poderia ser facilmente produzido em massa a um custo menor do que as lentes em câmeras convencionais.

“Embora a abordagem do design óptico não seja nova, este é o primeiro sistema que usa uma tecnologia óptica de superfície no front end e processamento baseado em neural na parte traseira”, disse Joseph Mait, consultor da Mait-Optik e ex-sênior pesquisador e cientista-chefe do Laboratório de Pesquisa do Exército dos EUA.

“A importância do trabalho publicado é completar a tarefa hercúlea de projetar em conjunto o tamanho, a forma e a localização dos milhões de recursos da metassuperfície e os parâmetros do processamento pós-detecção para atingir o desempenho de imagem desejado”, acrescentou Mait, que não estava envolvido no estudo.

Heide e seus colegas agora estão trabalhando para adicionar mais habilidades computacionais à própria câmera. Além de otimizar a qualidade da imagem, eles gostariam de adicionar recursos para detecção de objetos e outras modalidades de detecção relevantes para medicina e robótica.

Heide também prevê o uso de imageadores ultracompactos para criar “superfícies como sensores”. “Poderíamos transformar superfícies individuais em câmeras com resolução ultra-alta, para que você não precisasse mais de três câmeras na parte de trás do seu telefone, mas toda a parte de trás do seu telefone se tornaria uma câmera gigante. Podemos pensar em algo completamente diferente maneiras de construir dispositivos no futuro “, disse ele.

Publicado em 30/11/2021 17h13

Artigo original:

Estudo original: